这是一篇职称论文范文,本文提出的 FitNeSy 模型通过结合语义增强的知识图谱微调(KG-FIT)与神经–符号混合推理机制,有效提升了知识图谱中复杂逻辑查询的建模能力。模型能够在查询图中同时利用连续语义信息与符号结构特征,并在不同查询结构下平衡两种查询路径,从而增 强 了 表 达 能 力 与 结 构 泛 化 性 。 实 验 结 果 表 明 ,FitNeSy 在 NELL-995 与 FB15k-237 等数据集上显著优于现有主流方法,尤其在包含否定与并集的复杂逻辑推理任务中表现出更强的鲁棒性。尽管如此,模型在大语言模型生成语义描述的质量控制以及神经–符号融合的效率方面仍存在优化空间。未来将探索更加轻量化的语义增强方法与自适应的融合策略,以进一步提升复杂逻辑查询的建模能力与可扩展性,也可将FitNeSy 应用于包含文本、图像等异构知识源的跨模态逻辑查询,以进一步提升语义解释能力与实际应用范围。

知识图谱(Knowledge Graph, KG)作为一种以图结构形式组织海量实体及其关系的信息载体,近年来在智能问答、推荐系统、语义搜索以及对话系统等人工智能任务中得到广泛应用。随着应用需求的不断提升,用户在知识图谱中的查询已逐渐超越简单的实体关系匹配,涉及多步推理、逻辑组合与不确定性处理等更为复杂的查询任务。因此,如何在保证准确性与计算效率的前提下,高效处理复杂逻辑查询,已成为当前知识表示与推理研究中的关键问题[1]。在复杂逻辑查询任务中,研究者提出了多种不同的方法体系,主要包括基于嵌入的方法、基于符号推理方法、基于深度学习的方法以及近年来兴起的基于大模型的方法。早期嵌入方法(GQE[2]、Query2Box[3]、BetaE[4]等)把实体、关系和逻辑算子一并映射到连续向量空间,并通过几何运算近似实现逻辑推理,在简单查询上取得了一定效果[5][6]。符号推理方法(如早期TensorLog)较为精确执行包含否定算子的逻辑查询,但受限于知识图谱本身的不完备性(如缺失“教师-职业”边时,否定结果会遗漏合法实体),导致否定算子查询的 MRR 普遍低于其他算子,此外,还出现了将嵌 入 与 符 号 推 理 相 结 合 的 神 经 符 号 耦 合 方 法 ( 如EneSy[7]、FuzzQE[8]),这种方法试图融合符号逻辑的规则性与神经网络的表征能力,弥补纯粹学习范式在逻辑一致性方面的不足。随后,随着预训练大语言模型(如 KG Transformer[9]、KG-GPT[10]、BERT[11])的迅速发展,将自然语言处理领域的大模型引入到知识图谱逻辑推理中,成为一项新兴且富有前景的研究方向。近年来,大规模预训练语言模型为复杂逻辑推理注入新动力,凭借强大的语义表示与常识推理能力,在多项基准上再次刷新精度记录[12]。

知识图谱(Knowledge Graph, KG)作为一种以图结构形式组织海量实体及其关系的信息载体,近年来在智能问答、推荐系统、语义搜索以及对话系统等人工智能任务中得到广泛应用。随着应用需求的不断提升,用户在知识图谱中的查询已逐渐超越简单的实体关系匹配,涉及多步推理、逻辑组合与不确定性处理等更为复杂的查询任务。因此,如何在保证准确性与计算效率的前提下,高效处理复杂逻辑查询,已成为当前知识表示与推理研究中的关键问题[1]。在复杂逻辑查询任务中,研究者提出了多种不同的方法体系,主要包括基于嵌入的方法、基于符号推理方法、基于深度学习的方法以及近年来兴起的基于大模型的方法。早期嵌入方法(GQE[2]、Query2Box[3]、BetaE[4]等)把实体、关系和逻辑算子一并映射到连续向量空间,并通过几何运算近似实现逻辑推理,在简单查询上取得了一定效果[5][6]。符号推理方法(如早期TensorLog)较为精确执行包含否定算子的逻辑查询,但受限于知识图谱本身的不完备性(如缺失“教师-职业”边时,否定结果会遗漏合法实体),导致否定算子查询的 MRR 普遍低于其他算子,此外,还出现了将嵌 入 与 符 号 推 理 相 结 合 的 神 经 符 号 耦 合 方 法 ( 如EneSy[7]、FuzzQE[8]),这种方法试图融合符号逻辑的规则性与神经网络的表征能力,弥补纯粹学习范式在逻辑一致性方面的不足。随后,随着预训练大语言模型(如 KG Transformer[9]、KG-GPT[10]、BERT[11])的迅速发展,将自然语言处理领域的大模型引入到知识图谱逻辑推理中,成为一项新兴且富有前景的研究方向。近年来,大规模预训练语言模型为复杂逻辑推理注入新动力,凭借强大的语义表示与常识推理能力,在多项基准上再次刷新精度记录[12]。

1 相关工作

1.1 基于嵌入的复杂逻辑查询方法基于嵌入的方法是复杂逻辑查询研究中较早发展的研究方向,其核心思想是通过将知识图谱中的实体、关系和属性投影到低维向量空间来学习分布式语义表示。其中,几何嵌入方法最具代表性,其中 GQE[2]代表 了 神 经 网 络 处 理 知 识 图 谱 查 询 的 初 步 尝 试 ,Query2Box[3]利用高维超矩形(Box)来表示集合和关系,通过 Box 之间的几何操作(如交集和并集)完成复杂逻辑查询。这一方法因其计算效率高且具有几何直观性而被广泛应用。进一步的研究如 GumbelBox[14]。引入 Gumbel 分布,在嵌入几何空间的基础上处理不确定性逻辑查询,增强了模型对多样性和不确定性场景的适应能力。此外,BetaE[4]则通过 Beta 分布嵌入关系和实体,结合概率推理,为处理复杂的概率性逻辑查询提供了一种全新的视角。PERM[15]通过将知识图谱中的实体和关系编码为多变量高斯密度,利用均值和协方差参数来捕捉实体的语义位置和平滑的决策边界。尽管这类方法在效率和可解释性方面表现优异,但在处理高维复杂逻辑查询和动态知识图谱时仍存在一定的局限性,并且由于忽视了中间实体的重要性,仅关注目标答案,每一步运算都会将嵌入结果作为下一步的输入,这种递归操作会使嵌入空间中的误差不断累积,容易出现级联误差的问题。

1.2 基于深度学习的复杂逻辑查询方法基于深度学习的方法是复杂逻辑查询研究的核心发展方向之一,近年来在国内外学术界取得了广泛关注。该类方法的研究重点集中在如何利用深度学习模型增强知识图谱的逻辑推理能力。其中,图神经网络(GNN)被广泛应用,例如基于图注意力网络(GAT)的逻辑查询模型通过引入注意力机制,有效提高了知识图谱中复杂关系的建模能力。而 KG-Transformer[9]则利用 Transformer 的多头注意力机制对知识图谱进行高效表示,在处理复杂逻辑查询和大规模数据时表现出较优性能。与此同时,神经-符号耦合方法也逐渐成为研究热点。例如,EneSy[7]模型将符号逻辑的规则性和神经网络的学习能力结合,互相补充,以解决知识图谱中的复杂逻辑推理问题。同时,国内学者还研究了基于模糊逻辑 FuzzQE[8]的神经网络模型,通过模糊逻辑与深度学习的有机结合,实现了对不确定性逻辑查询的高效处理。相比于表示学习的方法,基于神经网络的方法具备更高的学习能力、逻辑建模能力,这些方法的共同特点是具有较强的泛化能力和灵活性,能够适应多样化的查询需求。然而,这类方法的计算复杂性较高,尤其是在处理超大规模知识图谱时,推理效率和模型复杂度仍然是研究的瓶颈问题。

1.3 基于大模型的复杂逻辑查询方法基于大模型的复杂逻辑查询方法是近年来随着预训练语言模型(Pre-trained Language Models, PLMs)和大语言模型(Large Language Models, LLMs)快速发展而兴起的新方向。研究者在这一领域的探索主要集中于如何将自然语言理解中的强语义能力与知识图谱的结构化推理机制相结合,以提升复杂逻辑推理的准确性与泛化性。KG-GPT[10]是将 GPT 类模型应用于知识图谱逻辑查询的代表性工作。该方法通过微调 GPT,使其能够基于知识图谱结构执行复杂逻辑推理,初步验证了LLM 在图结构数据上的推理潜力。随后,LARK[16]提出了一种逻辑链分解(logical chain decomposition)机制,将复杂的多运算逻辑查询分解为一系列单一逻辑操作子查询,并通过顺序调用 LLM 实现链式推理,从而显著缓解了大模型直接处理复杂逻辑时的“幻觉”问题。与此同时,LACT[17]框架进一步通过逻辑感知课程学习(Logic-aware Curriculum Learning)与二叉树

式分解(Binary Tree Decomposition),在 LLaMA2 上实现了复杂逻辑查询任务的显著性能提升,在 FB15K、NELL995 等数据集上取得新的 SOTA 结果。另一条研究路线,如 LGOT[18],结合了 LLM 与知识图谱推理模型(KGQA),通过将复杂逻辑查询拆分为可验证的子问题,并在每一步中交替利用 LLM 的生成能力与知识图谱的可验证性,从而实现了高精度的多步推理。此外,部分工作致力于将语义嵌入与图结构嵌入相结合,从而以弥合符号与语义间的鸿沟。例如,QUERY2BERT[19]模型将 Node2Vec 图嵌入与 BERT 语义嵌入结合,通过 K-D 树索引实现对实体的高效邻域搜索,并定义了基于几何空间的投影、交、并、否等逻辑操作,从而在处理多跳查询与不完备图谱时表现出优异的推理能力。整体而言,基于大模型的知识图谱逻辑查询方法呈现出语义驱动和结构约束的融合趋势。尽管如此,这类方法仍存在若干挑战:一是 LLM 对知识图谱不完 备 性 的 适 应 性 有 限 , 容 易 产 生 语 义 幻 觉(hallucination);二是逻辑操作的数学定义尚未完全形式化,导致模型难以在逻辑严谨性与自然语言表达间取得平衡。因此,如何在保持逻辑一致性的同时充分利用大模型的语义推理能力,仍是当前研究的关键问题。

2 FitNeSy 模型针对复杂逻辑查询中普遍存在的级联误差累积与否定算子推理不稳定问题,提出一种一个集成 KG-FIT语义增强与神经符号融合的完整复杂逻辑查询模型——FitNeSy(Fine-tuned Neural-Symbolic Reasoner)。与现有方法将语义增强、嵌入推理或符号遍历视为相互独立模块不同,FitNeSy 从整体推理范式出发,提出了一种语义增强驱动的神经–符号双通路协同推理框架:一方面利用大语言模型增强实体语义表示,为复杂逻辑算子提供稳定的语义基础;另一方面在查询执行过程中,通过连续嵌入推理与离散符号遍历的加权融合,逐步校正推理偏差,从而缓解多跳查询中的误差放大问题。FitNeSy 的整体结构如图 1 所示,模型由语义增强嵌入模块(KG-FIT)与神经–符号协同推理模块两部分组成,并通过端到端训练实现统一优化。

2.1 每个查询可构建为一个有向无环图(DAG),节点表示变量或锚点实体,边表示逻辑操作。目标是预测最终的答案实体集合中的文本是q 。

2.2 大模型语义增强投影器为克服传统嵌入方法在语义表示能力上的局限,在知识图谱嵌入时使用 KG-FIT 框架,利用大语言模型补充实体语义信息,从而提升嵌入质量。KG-FIT 模块通过融合大语言模型的全局语义与知识图谱的结构信息,对实体嵌入进行系统性优化,其作用可归纳为三方面:首先,利用大模型为每个实体生成自然语言描述,并将其与实体名称共同编码为复合语义向量,从而增强嵌入的上下文表达能力;其次,基于语义向量构建层次化聚类结构,并通过大模型引导的细化操作(簇分裂、合并与祖先调整)建立语义一致的层次约束,为嵌入空间引入显式的语义组织信息;最后,通过联合优化层次聚类损失、语义锚定损失与链接预测损失,在保持图谱结构特性的同时,约束嵌入向量不偏离原始语义,有效缓解稀疏场景下的语义漂移问题。表 2 结果表明,KG-FIT 在 FB15k-237 数据集上显著提升多种基线模型的投影性能,各基线模型 Hits@k(k=1,5,10)指标均有所提升,验证了其在增强实体嵌入表达能力与结构一致性方面的有效性,为后续复杂逻辑查询任务提供了更为鲁棒的语义基础。

3 实验结果及分析

3.1 实验设置实验在 Windows11 操作系统下进行硬件环境包括Intel(R) Core(TM) i9-14900K CPU 和 NVIDIA Ge-Force RTX 4090D GPU 软件框架是基于PyTorch1.12.1 的深度学习统一训练框架,开发语言为 Python。

3.1.1 数据集实验在 BetaE 中提供的基准数据集上评估模型,包括 FB15k-237[20]和 NELL995[21]两个数据集。两个数据集均包含 14 种逻辑查询类型。

3.1.2 基准模型为了公平比较,在基准模型选择方面,覆盖了多种具有代表性的技术路线,包括几何嵌入方法(GQE[2]、Query2Box[3])、模糊逻辑方法(QTO、FuzzQE[8]、Var2vec[22] ) , 以 及 基 于 大 语 言 模 型 的 推 理 方 法(LARK[16]、PPMT[23]、MLP[24]),从而能够较为全面地验证所提出模型在不同推理范式下的相对优势。GQE:将图查询嵌入到向量空间中,通过构建查询图的嵌入表示,使用可微操作(如交、投影等)来模拟逻辑查询路径,使得模型能够在知识图谱中处理复杂的逻辑推理任务。Query2Box:该模型将查询嵌入为超矩形,并将答案嵌入为矩形内的点。FuzzQE:把查询与实体共同嵌入到 的模糊向量空间,用无参数的模糊合取、析取、否定运算实现逻辑算子;通过元素级 t-范数/t-余范数保持逻辑公理,无需复杂查询训练即可泛化到新结构。QTO:将复杂逻辑查询转换为树型计算图,通过前向—后向传播在“查询计算树”上精确求解最优实体赋值;利用树结构的独立性压缩指数级搜索空间,仅依赖预训练链接预测器即可达到理论最优,同时可解释中间变量。FIT:该模型结合神经链接预测器与模糊逻辑推理的神经符号方法,用于高效准确地回答知识图谱上的任意复杂存在一阶逻辑查询。PPMT:通过前缀记忆校正机制消除序列化查询中的语言噪声,并结合渐进式条件梯度更新策略提升PLM 对复杂逻辑语义的建模能力。

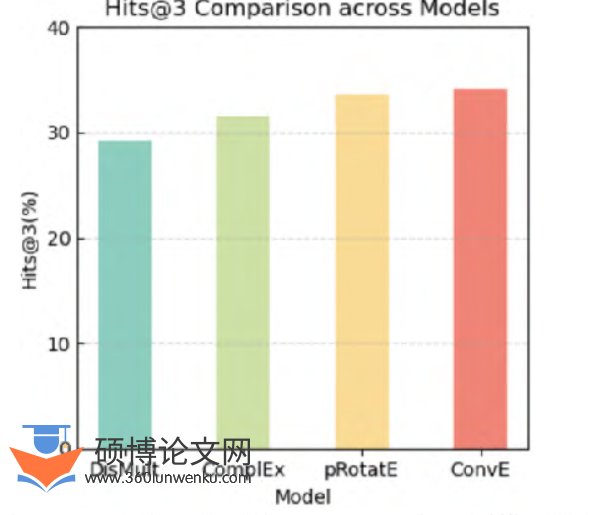

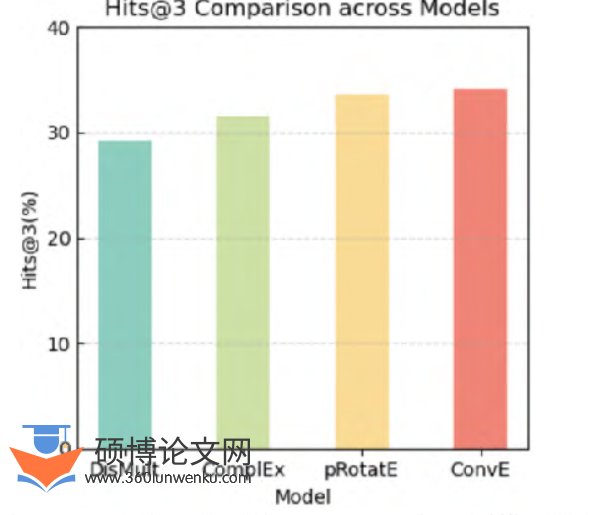

3.1.3 评价指标使 用 的 评 价 指 标 包 括 平 均 倒 数 秩 (MRR)[25] 和Hits@k (k=1、3、10)[26]。MRR 反映了正确三元组排名的平均倒数秩。Hits@k 反映了前 k 个正确三元组排名的比例。

3.1.4 参数设置在实验中,实体与关系嵌入维度统一设置为 400,该设置与 BetaE、LACT 等主流复杂逻辑查询模型保持一致,以保证对比的公平性。神经投影函数采用两层MLP 结构,隐藏层维度设置为 800,激活函数为 ReLU。KG-FIT 模块中,语义描述编码所使用的大语言模型参数保持冻结,仅对知识图谱嵌入参数进行微调,以避免过拟合并降低训练成本。层次约束损失、语义锚定损失与链接预测损失之间的权重比例参考 KG-FIT 原文设置,并在验证集上进行微调以适配复杂逻辑查询任务。所有模型均采用 Adam 优化器进行训练,初始学习率设为 1e-4,batch size 为 512,训练过程在验证集指标不再提升时提前终止。

4 结束语本文提出的 FitNeSy 模型通过结合语义增强的知识图谱微调(KG-FIT)与神经–符号混合推理机制,有效提升了知识图谱中复杂逻辑查询的建模能力。模型能够在查询图中同时利用连续语义信息与符号结构特征,并在不同查询结构下平衡两种查询路径,从而增 强 了 表 达 能 力 与 结 构 泛 化 性 。 实 验 结 果 表 明 ,FitNeSy 在 NELL-995 与 FB15k-237 等数据集上显著优于现有主流方法,尤其在包含否定与并集的复杂逻辑推理任务中表现出更强的鲁棒性。尽管如此,模型在大语言模型生成语义描述的质量控制以及神经–符号融合的效率方面仍存在优化空间。未来将探索更加轻量化的语义增强方法与自适应的融合策略,以进一步提升复杂逻辑查询的建模能力与可扩展性,也可将FitNeSy 应用于包含文本、图像等异构知识源的跨模态逻辑查询,以进一步提升语义解释能力与实际应用范围。