第 1 章 绪论

1.1 研究背景及意义

2016 年,在世界瞩目的围棋大战中,谷歌团队研发的 AlphaGo 机器人成功挑战了李世石,这一次的人机围棋博弈引发了人们对人工智能的热议,并且推动了人工智能技术的研究和发展。2017 年,我国把人工智能提升到国家战略层面上,从而推动着国内新一轮的科技发展和产业创新。现如今,人工智能影响着人民生活的方方面面,给我们日常工作和生活带来了极大的便利。比如,手机从以前的指纹识别到现在的人脸识别、小米公司研发的手机内置语音助手小爱同学,以及目前流行的扫地机器人、同传翻译等等。这些都得益于人工智能的快速发展,尤其是机器学习和深度学习的研究发展。深度学习被广泛应用到计算机视觉领域,研究人员在卷积神经网络和循环神经网络的基础之上进行创新和改进,使得目标检测[1,2]、图像识别[3]、机器翻译[4,5]等任务得到空前发展。

尽管深度学习技术在图像理解领域方面已有突出表现,但在如何让计算机使用正确的语句描述一幅图像包含的内容这一任务还是存在很大的挑战性。一方面,图像描述生成是跨不同领域的复杂性任务,主要是结合了计算机视觉中特征提取网络和自然语言处理中语言模型两大领域的任务;另一方面,图像描述不仅需要识别出图像包含的内容,属性,以及物体之间的联系,还需要在生成的自然语句表达上具有正确的语法格式和丰富的语句内容。例如,当我们给计算机一副一家人在吃晚饭的图片,我们不仅希望计算机能识别出图像中人物数量,桌子上摆放的食物以及场景,而且我们更愿意让计算机理解这幅图像和传达出图像内容,并使用自然语言描述出来“在敞亮的客厅中,四个人坐在餐桌前吃着丰盛的晚餐,他们看起来非常的高兴。”

近年来,随着深度学习技术的发展,图像描述任务的研究相比传统方法已经取得较为显著的效果。可是与人相对比,计算机对图像内容的理解仍有一定差距,图像描述生成这种跨模态的问题还是有待解决的。作为人工智能领域的热点问题,图像描述任务的研究在学术和生活中都具有重要意义。例如,图像描述可以当做是盲人的助手,它可以做到实时收集周围环境信息,并生成相应文字信息,再从文字转换成语音的形式将周围信息传递给盲人。这种方法能够有效地帮助盲人解决生活中衣食住行问题。另外,随着互联网的发展,短视频受到人们越来越多的喜爱。为了使观看者能够更好的理解视频内容,尤其是那些语言不同的短视频,视频字幕可以给视频浏览者带来更好的浏览体验。一个 5分钟左右的视频就会有 15000 张左右的图片,尽管不需要每一张图像都要加上字幕,但是人工添加字幕仍是一项非常繁琐的任务,而通过图像描述可以自动的为视频每一帧图像处理,从而生成视频字幕,大大减少工作量。

..............................

1.2 国内外研究现状

图像描述任务是将计算机视觉中图像特征提取技术和自然语言处理输出序列数据技术相结合。一方面,该任务要求模型能够有效识别图像并提取图像特征信息;另一方面,该任务需要依据自然语言处理技术中提取到的图像特征信息来生成图像描述语句,这一综合性具有跨模态的任务引起了研究者的极大的兴趣。图像描述发展早期研究者们提出基于模板的图像描述模型,然而学者们发现基于模板的方法生成的语句灵活性不强,进而提出了基于检索的图像描述算法。目前,根据计算机视觉和自然语言处理的任务的探索与研究,学者们提出基于深度学习的图像描述算法,尤其是以编码器-解码器框架为基础的模型算法以及注意力机制的加入,更是推进了图像描述算法的研究进程。下面将详细介绍国内外学者们对图像描述算法的研究现状。

1.2.1 基于模板的图像描述方法

在图像描述研究早期,学者们提出了基于模板的方法来完成图像描述任务。这种方式最基本的是获取图像中目标、场景、属性以及三者之间的关系等信息,然后根据人工设置好的词槽,将获取的视觉信息填充到词槽中。该方法需要检测一个特定的视觉概念集,然后将检测到的视觉概念集连接起来,形成一个逐句的模板、指定的语言语法规则或组合优化算法,从而生成图像描述语句。

在图像描述研究早期,学者们提出了基于模板的方法来完成图像描述任务。这种方式最基本的是获取图像中目标、场景、属性以及三者之间的关系等信息,然后根据人工设置好的词槽,将获取的视觉信息填充到词槽中。该方法需要检测一个特定的视觉概念集,然后将检测到的视觉概念集连接起来,形成一个逐句的模板、指定的语言语法规则或组合优化算法,从而生成图像描述语句。

2010 年,Farhadi 等[6]通过支持向量机(Support Vector Machine,SVM)训练分类器,利用分类器获取图像的中包含的目标物体、目标属性、动作等视觉信息,并将捕捉到的这些信息组成一个三元组的结构(比如,Motorcycle,Drive,Highway),然后使用预先设计好的句子模板将三元组信息插入进去,得到图像描述语句。2011 年,Li 等[7]人提出根据对三元组模板进行填充来生成不同的短语,然后借助动态规划算法来寻求最适合的短语组合,最后通过基于模板或者随机局部搜素,这两种方法中的一种生成更为复杂的短语语句,从而组合成描述语句。2013 年,Kulkarnil 等[8]人提出利用条件随机场(Conditional Random Field, CRF)从图像捕捉物体目标、目标属性等信息来推理他们之间的关系,最后将得到的信息插入预先设计好的语言模板中生成图像描述语句。

................................

第 2 章 基于深度学习图像描述的相关基础理论

2.1 编码器-解码器框架

相较于其他的图像理解任务,图像描述首先要准确识别出图像中包含哪些目标,以及目标物体与目标物体之间的关系,并通过符合人类表达的自然语言描述出图像。学者们提出的基于深度学习的图像描述模型算法描述图像内容的准确性越来越高。与基于模板和检索的方法相比,基于神经网络的算法不仅提升了描述内容的句子灵活性越高,而且在准确度以及性能上更有优势。本章首先介绍基于神经网络的图像描述算法的相关理论知识,以及在图像描述模型训练期间常用的优化算法的方法。

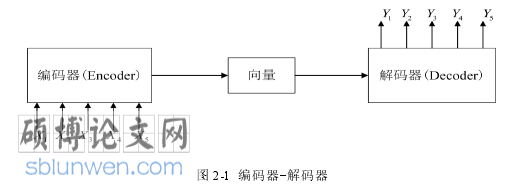

在深度学习领域中,编码器-解码器框架[31,32]最开始是应用于机器翻译领域的一种模型框架,主要是 Encoder 模块利用卷积神经网络将序列信息编码成向量,而 Decoder 模块使用循环神经网络将中间向量进行解码,从而获得输出单词,如图 2-1 所示:

计算机论文怎么写

..................................

2.2 注意力机制

研究人员通过观察人类在注意视觉信息时眼睛的状态提出了在网络模型中通过应用注意力机制来使得网络模型也能达到关注图像中需要关注的区域,就像人类在看图像时,会无意识的将注意力放在图像中物体目标上,或者特别重点的区域,从而无关紧要的信息被抑制。如图 2-2 所示,可以出看人类在看图像时,人类如何将自己的视觉系统进行分配以达到获取重要信息的,在图像中红色区域表示人类更加关注该区域。

深度学习中研究人员就利用注意力机制达到让机器和人类视觉注意力机制一样的效果,例如翻译任务中运用注意力可以达到输入的序列单词可以通过模型预测出接下来的输出单词,在图像描述任务中可以有效的帮助语言模型生成的单词的时更多关注图像某些区域。最初注意力机制应用到机器翻译领域,随着研究人员的创新和改进在图像描述领域也得到广泛应用并取得良好的效果。

在计算机视觉领域中卷积神经网络取得了重大成果,在商业和工业上有着广泛的应用。卷积神经网络是一种具有卷积计算能力和深度机构的前馈神经网络,它的出色之处主要在于卷积神经网络具有局部连接、权重共享、池化下采样等特性,从而降低了网络训练的复杂性和过拟合现象发生的概率,并且有助于提高网络整体的泛化能力。在图像描述任务中,卷积神经网络的作用是提取图像特征信息向量,相比传统方法中的数据处理等简化了很多流程,且对于特征向量的提取过程是模型自动完成的。卷积神经网络基本框架如图 2-4 所示,其中神经网络中最为重要的是卷积层、池化层和全连接层。接下来会详细介绍神经网络中每个结构的工作原理等理论。

............................

第 3 章 基于区域网络的图像高层语义提取方法 ............... 24

3.1 基于 VGGNet-16 的全局图像特征信息提取....................... 24

3.1.1 VGGNet 的网络结构及特点 ........................... 24

3.1.2 基于 VGGNet-16 的图像特征提取预训练 ............................ 26

第 4 章 基于 Attention 机制的图像描述方法 ................... 35

4.1 基于 Word2Vec 的词嵌入方法 .................................. 35

4.1.1 Skip-Gram 网络模型 .................................. 36

4.1.2 Skip-Gram 网络训练 ........................... 37

第 5 章 实验结果与分析 ................................... 48

5.1 实验环境 ................................ 48

5.1.1 硬件环境 ..................................... 48

5.1.2 软件环境 ................................... 49

第 5 章 实验结果与分析

5.1 实验环境

由于本文研究的图像描述方法是基于深度学习的整体网络模型,网络模型对计算机的硬件和软件环境要求比较高。本节将对本文的实验环境中的硬件和软件环境的详细配置进行介绍。

5.1.1 硬件环境

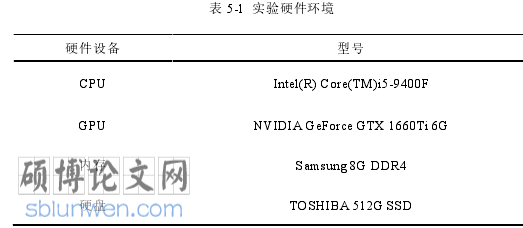

本文实验使用的计算机是专门用于深度学习的机器,具体的硬件配置如表5-1 所示:

计算机论文参考

第 6 章 总结与展望

6.1 总结

近年来随着研究人员对神经网络的不断研究与探索,图像描述任务作为计算机视觉和自然语言处理两大领域的交叉点也得到了不断地创新和优化,并在实际日常生活中得到广泛的应用,比如盲人助手、视频字幕等。本文首先介绍了图像描述研究的背景和意义,然后介绍传统的图像描述方法,以及基于神经网络的国内外研究现状,从而分析出现有的基于神经网络的方法在提取图像特征时特征向量尺度单一、没有注意到图像中高层语义信息的提取的问题。另外,在解码器中应用的传统注意力机制过于单一,不能有效过滤冗余的信息,从而导致解码器输出错误的图像描述。为了解决上述问题,本文在基于编码器-解码器框架的基础上提出基于高层语义提取与 Attention 机制的图像描述方法。

首先,提出了基于区域网络的图像高层语义提取方法。将 VGGNet-16 网络模型在 ImageNet 数据集上进行预训练,删除 VGGNet-16 网络最后的全连接层和分类层,以卷积层的输出特征信息作为图像的全局的特征信息向量,接着通过区域建议网络生成候选区域框,利用非极大值抑制法对候选区域筛选,再通过采样网格和双线性插值来对特征向量和坐标进行反向传播和训练,这样有助于捕捉图像目标物体,删除多余的候选框。最终将获得的局部特征向量和全局特征向量相结合作为图像描述方法中解码器的输入信息。

然后,提出基于 Attention 机制的图像描述方法。由于空间注意力直接作用于解码器不能提高解码器的输出结果,因而需要对空间注意力机制进行改进。首先在空间注意力后加上两个线性变化生成信息向量和注意门,这样可以有效的帮助解码器过滤冗余的信息,然后在解码器中引入视觉注意力机制可以达到使解码器自动决定依赖语言信息还是视觉信息,最后通过改进的空间注意力和视觉注意力能够使得解码器输出更高质量的图像描述语言。

最后,通过 MS COCO 数据集和 Flickr 30K 训练网络模型以及测试,并与目前较为流行的图像描述方法相比较,从而验证本文的方法在自动评价指标上优于对比的方法。此外,通过图像描述示例可以看出本文方法生成的语句描述更加生动和关注图像细节内容。

参考文献(略)